رؤى

أشرف إبراهيمالتكنولوجيا، والمشاعر، والهوية الإنسانية

2025.07.05

مصدر الصورة : آخرون

التكنولوجيا، والمشاعر، والهوية الإنسانية

صارت التكنولوجيا المعاصرة بمثابة العمود الفقري لحياة الإنسان اليومية، حيث تتجاوز وظيفتها الميكانيكية لتتغلغل في الوجدان والهوية، مؤثرة في الطريقة التي نشعر بها، نحب بها، نغضب، نحزن، ونفكر. لم تعُد المشاعر بمعزل عن الأجهزة، ولم تعُد الهوية متحررة من المنصات الرقمية. بل صارت التكنولوجيا تشكل، تُعيد إنتاج، وأحيانًا تُدمر ما يُعرف بـ"الذات الإنسانية".

في هذه المقالة، نتناول بالتحليل والتمحيص كيف صارت التكنولوجيا أداة للتحكم في المشاعر، وساحة للصراع على الهوية، ومساحة جديدة تتشكل فيها العلاقات والتفاعلات الإنسانية، مستعرضين قضايا الحوسبة العاطفية، التلاعب بالمشاعر عبر الإنترنت، والتحديات الأخلاقية الناجمة عن ذلك.

أولًا: تغير المشاعر الإنسانية في العصر الرقمي

1- مشهد عام للتحول العاطفي

في العقود الماضية، كانت المشاعر الإنسانية تتشكل وتتفاعل ضمن أطر الحياة الواقعية: الأسرة، المجتمع، العلاقات المباشرة، التجارب اليومية. أما اليوم، فقد صارت المشاعر تُستثار وتُوجَّه عبر الشاشات والمنصات الرقمية.

الملاحظ هو تراجع العمق العاطفي وظهور نمط جديد من المشاعر:

- سريعة الزوال.

- سطحية.

- موجهة بالخوارزميات.

- ومُستهلَكة ضمن سياق ترفيهي أو تفاعلي.

2- مفهوم "السكتة العاطفية" أو الجمود الشعوري

هذا المصطلح يشير إلى حالة من الخدر النفسي، حيث يشعر الفرد بأنه غير قادر على الإحساس الحقيقي: لا فرح، لا حزن، فقط حياد داخلي مزمن.

الأسباب:

- التحفيز المستمر للمشاعر :

يتلقى الفرد آلاف الرسائل العاطفية عبر الإعلانات، الفيديوهات، والميمات؛ ما يؤدي إلى تشبّع النظام العصبي وفقدان القدرة على الاستجابة.

- فقدان التفاعل الإنساني الحقيقي :

التفاعل الرقمي يُختزل في رموز تعبيرية (emojis)، ما يُضعف القدرة على فهم المشاعر العميقة المعقدة.

- المقارنة المستمرة :

المستخدمون يُقارنون أنفسهم بما يُعرض في حياة الآخرين الرقمية (النجاح، السعادة، السفر)، مما يولد شعورًا بـ"انعدام القيمة" و"اللاشيء".

ثانيًا: الحوسبة العاطفية - علم جديد للتحكم في الإنسان

- ما هي الحوسبة العاطفية؟

الحوسبة العاطفية هي فرع ناشئ من علوم الذكاء الاصطناعي يهدف إلى تطوير أنظمة قادرة على التعرف على مشاعر الإنسان والتفاعل معها. تعتمد هذه التقنية على أدوات، مثل: تحليل تعبيرات الوجه، نبرة الصوت، معدل ضربات القلب، واستجابات الجلد، لتحديد الحالة الشعورية بدقة. لكنها لا تكتفي بالفهم، بل تسعى أيضًا إلى التأثير، ما يفتح الباب أمام التحكم العاطفي شبه المباشر.

تُستخدم الحوسبة العاطفية في: الإعلانات، الألعاب، التعليم، وحتى الصحة النفسية، حيث تُضبط التجربة حسب مزاج المستخدم. لكنها أيضًا تُستغل في توجيه الرأي العام، وتشكيل الاستجابات الجماعية، وحتى التلاعب النفسي لتحقيق أهداف تجارية أو سياسية.

تكمن الخطورة في أن الإنسان قد يُعامل كمجرد "بيانات شعورية"، يُقاس ويُعدل حسب احتياجات السوق أو النظام، ما يهدد مفهوم الحرية العاطفية والخصوصية النفسية. فبدلًا من أن تظل المشاعر تجربة إنسانية خالصة، تصير مُراقَبة ومُستغَلة. وهذا يدعو إلى طرح تساؤلات أخلاقية عميقة حول الحدود الفاصلة بين الدعم التقني وبين السيطرة على الذات الإنسانية.

|

الجهاز |

الوظيفة |

الوصف |

|

سنتوجراف |

قياس المشاعر |

يقيس استجابة الأصابع لمؤشرات الحزن أو الغضب |

|

تقنيات التعرف على الوجه |

تحليل التعبيرات |

تُحول تعبيرات الوجه إلى رموز رقمية تمثل المشاعر |

تهدف هذه التقنيات إلى بناء أنظمة تتفاعل "عاطفيًّا" مع المستخدم، وتُعدّل محتواها أو رسائلها وفقًا لحالته الشعورية، وهو ما يستخدم اليوم في التسويق، الألعاب، وحتى التعليم.

ثالثًا: التلاعب بالمشاعر عبر الإنترنت

- من التسلية إلى السيطرة

في البداية، كان الإنترنت فضاء للتواصل الحر وتبادل الأفكار والمشاعر، لكن مع تطور الذكاء الاصطناعي وتحليل البيانات، تحوّل هذا الفضاء إلى ساحة منظمة لتوجيه العواطف. لم يعد التلاعب بالمشاعر يتم عبر الصدفة أو العشوائية، بل صار يُدار بأساليب علمية دقيقة تهدف إلى خلق استجابات نفسية محددة لدى المستخدمين.

"المتصيدون الرقميون"، هم أفراد يتعمدون إثارة الغضب أو الاستفزاز، يمثلون النموذج الأولي للتلاعب العاطفي. فهم يستخدمون تعليقات مستفزة أو محبطة لإثارة ردود فعل حادة، غالبًا بدافع البحث عن الاهتمام أو السيطرة على الحوار. شخص يُتقن استفزاز الآخرين وفق نمط مدروس، معتمدًا على علم النفس السلوكي.

لكن الأخطر من هؤلاء الأفراد هي الأنظمة الرقمية الصناعية - أي شركات التكنولوجيا العملاقة التي تمتلك القدرة على تحليل مشاعر ملايين المستخدمين في الزمن الحقيقي، وتوجيه المحتوى بناء على حالتهم الشعورية. تقوم هذه الأنظمة بتعديل خوارزميات العرض لتُبرز محتوى يزيد من التفاعل، ولو كان على حساب السلامة النفسية للمستخدم.

هذا التلاعب لا يُمارَس فقط بدافع التسلية أو الاستفزاز، بل لأهداف تجارية أو سياسية: توجيه الرأي العام، تعزيز الإدمان على المنصة، رفع معدلات الإعلانات، أو حتى زرع أفكار معينة داخل الوعي الجمعي. وهكذا، تتحول وسائل التواصل إلى أدوات للسيطرة الشعورية، تُصنع فيها المواقف والانفعالات، لا نتيجة تفكير، بل استجابة مبرمجة بعناية.

|

العنصر |

أفراد |

الشركات التكنولوجية الكبرى |

|

الهدف |

الاستفزاز |

الربح عبر التأثير العاطفي |

|

الوسيلة |

رسائل هجومية مباشرة |

خوارزميات ذكية وتحليل بيانات |

|

النتيجة |

اضطرابات نفسية |

تشكيل سلوك المستهلك وتوجيه الرأي |

رابعًا: وسائل التواصل كمصانع للمشاعر الجماعية

في العصر الرقمي، لم تعد وسائل التواصل مجرد أدوات لنقل المعلومات أو الترفيه، بل صارت مصانع حقيقية لإنتاج وتوجيه المشاعر الجماعية. المنصات مثل "تيك توك" تُستخدم بشكل منهجي في بعض الدول لصياغة الوعي العام، والتأثير في الانتماءات الوطنية، وتوجيه المزاج الشعبي. في روسيا مثلًا، يتم استثمار المنصة في بث محتوى يُثير مشاعر الفخر القومي، يعزز الولاء للدولة، ويُروج لصورة نمطية عن التفوق العرقي والهوية الروسية النقية.

تعتمد هذه الرسائل على أسلوب عاطفي مكثف، حيث تُستخدم الموسيقى، والصور الرمزية، والتكرار البصري لبناء حالة شعورية جماعية تلقائية. ومن خلال التكرار اليومي، يتحول المحتوى إلى أدوات برمجة لا واعية تُشكل قناعات وسلوكيات المشاهدين، خصوصًا الفئات العمرية الأصغر.

أما الأطفال والمراهقون، فهم الفئة الأكثر تأثرًا بهذا النوع من المحتوى. فهم يقضون ساعات طويلة في مشاهدة مئات المقاطع المتتالية التي تتلاعب بمشاعرهم بشكل لحظي وسريع. هذا التحفيز المستمر يُضعف قدرتهم على الشعور الطبيعي، ويخلق فجوة بين التجربة الرقمية والحياة الواقعية. فيصير الطفل عاجزًا عن التعبير العاطفي الحقيقي، ويشعر بفراغ داخلي كلما ابتعد عن الشاشة.

تزداد المشكلة عندما يتحول التفاعل الرقمي إلى بديل عن العلاقات الحقيقية، ما يؤدي إلى الإدمان والعزلة الاجتماعية، وتراجع القدرة على بناء هوية مستقلة. بهذه الطريقة، لا تُصنع فقط مشاعر فردية عابرة، بل يُعاد تشكيل الحس الجماعي والهوية بطريقة مبرمجة وموجهة.

خامسًا: تشكيل السلوك والهوية عبر التكنولوجيا

في العصر الرقمي، لم تعُد التكنولوجيا مجرد وسيلة مساعِدة للإنسان، بل صارت أداة لتشكيل سلوكه وهويته بطريقة منهجية. تعتمد كثير من التطبيقات اليوم على النموذج السلوكي الذي طوّره عالم النفس "بي. إف. سكنر"، الذي يقوم على مبدأ "التعزيز والعقاب"، حيث يُكافأ السلوك المرغوب ويُردع السلوك غير المرغوب.

هذا النموذج يُطبّق حاليًّا في ألعاب تعليمية وتطبيقات تربية الأطفال التي تستخدم الألوان، الأصوات، والنقاط لتحفيز الطفل على تكرار سلوك معين أو تجنّب آخر. قد يبدو هذا إيجابيًّا على السطح، لكنه يحمل في طياته تحكمًا خفيًّا في الإرادة والسلوك، خصوصًا حين يُستخدم على نطاق واسع لتوجيه جماعي.

|

الهدف |

التطبيق العملي |

|

تشكيل سلوك الأطفال |

تعزيز عادات إيجابية تدريجية |

|

تقليل السلوك السلبي |

تنبيهات صوتية أو بصرية للتنفير |

|

توجيه سلوك الجماهير |

رسائل سياسية، إعلانية، أو أيديولوجية |

المشكلة الأخلاقية الكبرى تكمن في السؤال: من يحدد السلوك "الصحيح"؟ وهل يجوز لأي جهة -سواء كانت تجارية أو سياسية- أن تُشكّل السلوك الجمعي بناء على مصالحها؟

أما على مستوى الهوية، فإن وسائل التواصل تمارس دورًا أكثر عمقًا. من خلال المحتوى الموجّه، يمكن الترويج لهوية وطنية معينة تقوم على: الفخر القومي، كراهية الآخر، وتمجيد الدولة. وهكذا، لا يُترك تشكيل الهوية للخبرات الفردية، بل يُعاد إنتاجه رقميًّا عبر مقاطع وشعارات تتكرر يوميًّا، ما يُحوِّل الهوية إلى منتج مصمم وفق رغبات السلطة أو السوق، لا تعبير حر عن الذات.

سادسًا: نحو مستقبل تتحكم فيه التكنولوجيا في المشاعر

يتجه العالم بسرعة نحو مستقبل يصير فيه قراءة المشاعر البشرية وتحليلها لحظيًّا أمرًا ممكنًا بفضل التقدم الهائل في تكنولوجيا الذكاء الاصطناعي والأجهزة القابلة للارتداء. هذه الأنظمة لن تكتفي فقط بفهم مشاعرنا، بل ستتفاعل معها فورًا، وتُعيد تشكيل تجاربنا الحياتية بناء على ما نشعر به في اللحظة.

باستخدام مجسات عصبية وسوار ذكي أو سماعة رأس متصلة بنظام تحليل عاطفي، ستتمكن التكنولوجيا من قياس مؤشرات، مثل: معدل ضربات القلب، تعابير الوجه، حركة العين، وحتى الإشارات الكهربائية في الجلد، لتحديد الحالة الشعورية بدقة شديدة.

التطبيقات المحتملة لذلك عديدة وخطرة في آنٍ واحد :

- في التعليم، سيُعدل محتوى الدرس تلقائيًّا إذا شعر الطالب بالملل أو الضغط، ما قد يعزز التركيز، ولكن يفتح بابًا للتحكم في طريقة التعلم .

- في التسويق، ستُطلق الإعلانات في اللحظة التي يشعر فيها المستخدم بالضعف أو الرغبة، ما يجعل القرار الاستهلاكي أقل وعيًا .

- في الطب النفسي، ستُراقب الحالات الشعورية بشكل دائم، ما يسهم في التدخل المبكر، لكنه قد يؤدي أيضًا إلى انتهاك الخصوصية الشعورية .

لكن هذه القدرات تثير جملة من المخاطر الأخلاقية والإنسانية :

- هل يحق لأي نظام أن يعرف ماذا نشعر قبل أن نفهم نحن أنفسنا؟

- ما مصير الحرية الداخلية إذا صارت مشاعرنا مكشوفة، قابلة للتعديل، أو حتى للتلاعب؟

- ماذا يحدث لهويتنا حين تتحول العاطفة من تجربة شخصية فريدة إلى بيانات قابلة للقياس والمعالجة التجارية؟

- إن مستقبل التحكم في المشاعر، رغم وعوده الطبية والتعليمية، يتطلب وعيًا جماعيًّا ومواثيق أخلاقية لحماية جوهر الإنسان من أن يتحول إلى مجرد "كائن قابل للبرمجة الشعورية".

|

الجانب الإيجابي |

الجانب السلبي |

|

تخصيص الدعم النفسي |

انتهاك الخصوصية العاطفية |

|

تحسين الخدمات التعليمية |

التلاعب بسلوك المستهلك والمواطن |

|

فهم أعمق للمشاعر البشرية |

توظيف العواطف لخدمة أجندات سلطوية |

المخاطر المحتملة

سابعًا: القضايا الأخلاقية والإنسانية

مع تصاعد قدرات التكنولوجيا في قراءة المشاعر والتأثير فيها، تبرز تساؤلات أخلاقية وجودية عميقة: هل من المشروع أن تُختزل الأحاسيس الإنسانية في رموز رقمية؟ وهل من المقبول أن تُستغل هذه المشاعر، التي تُعتبر من أعمق خصائص الإنسان، لأغراض تسويقية أو سياسية أو أمنية؟

إن اختزال المشاعر -الحب، الغضب، الخوف، والفرح- في إشارات كهربائية أو أنماط رقمية، قد يبدو علميًّا في ظاهره، لكنه يُهدد "جوهر الإنسان"، ذاك الجوهر الذي يجعل كل تجربة شعورية فريدة ولا تُختزل في بيانات.

المشاعر ليست مجرد ردود أفعال فيزيولوجية، بل هي تجارب داخلية متجذرة في الوعي والروح ، نابعة من التاريخ الشخصي، والذاكرة، والثقافة، والوعي الذاتي.

تكمن الخطورة في أن أنظمة الذكاء الاصطناعي، القائمة على الخوارزميات، لا تفهم "المعنى" بقدر ما تحلل "النمط"، وبالتالي فإنها تتعامل مع الإنسان ككائن قابل للتوقع، والتوجيه، بل والتعديل. وهنا يفقد الإنسان استقلاليته العاطفية، ويبدأ في التشكيك في صدق مشاعره: "هل ما أشعر به حقيقي؟ أم نتيجة خوارزمية مصممة لتثيرني؟"

علاوة على ذلك، تُطرح أسئلة مقلقة حول العدالة والخصوصية :

- من يملك حق الوصول إلى مشاعري؟

- من يتحكم فيها؟

- هل من حق الشركات أن تستخدم حزني أو ضعفي لزيادة أرباحها؟

لذلك، يجب أن تكون هناك ضوابط قانونية، وأخلاقية، وإنسانية صارمة ، لضمان ألا تتحول التكنولوجيا من أداة لفهم الإنسان إلى أداة لإخضاعه وتشكيله وفق مصالح غير إنسانية.

خاتمة: بين التكنولوجيا والإنسانية - أي مستقبل نريد؟

في ضوء التطورات السريعة في تكنولوجيا الذكاء الاصطناعي والحوسبة العاطفية، صار من الواضح أن التكنولوجيا لم تعُد مجرد أداة مساعِدة في حياة الإنسان، بل صارت قوة قادرة على تشكيل المشاعر، وتوجيه السلوك، وإعادة صياغة الوعي والهوية . هذه القدرة غير المسبوقة تضع البشرية أمام مفترق طرق: إما أن نُحسن استخدام هذه الأدوات لخدمة الإنسان، وإما نسمح لها بالتحكم فينا باسم الراحة والتقدم.

المطلوب اليوم ليس رفض التكنولوجيا أو العزلة عنها ، بل وعيًا نقديًّا يميز بين الاستخدام المشروع والإساءة المقنعة. نحتاج إلى أطر قانونية وأخلاقية تضمن أن تظل التكنولوجيا خادمة للإنسان، لا مُهيمنة عليه. أدوات، مثل تحليل المشاعر أو تعديل السلوك قد تُستخدم في التعليم أو العلاج، لكن دون رقابة قد تتحول إلى وسائل للسيطرة والتسليع.

الإنسان يجب أن يبقى هو المتحكم في مشاعره، قراراته، وهويته. لا يجب أن يُختزل إلى "مستخدم"، بل أن يُعامل ككائن حر ذي كرامة. الهوية الإنسانية لا تُبرمج ، بل تُبنى عبر التجربة، العلاقة، والمعنى.

إذا فقد الإنسان قدرته على الشعور العفوي، والتفكير الحر، والتفاعل الإنساني الصادق، فلن يكون سوى قشرة رقمية تُدار من الخارج.

لهذا، فإن المستقبل الذي نريده هو ذلك الذي تُسخّر فيه التكنولوجيا لخدمة الإنسان، لا للهيمنة عليه.

مستقبلٌ يحتفظ فيه الإنسان بخصوصيته، ووعيه، وحقه في أن يكون إنسانًا حقيقيًّا في عالمٍ تملؤه الآلات .

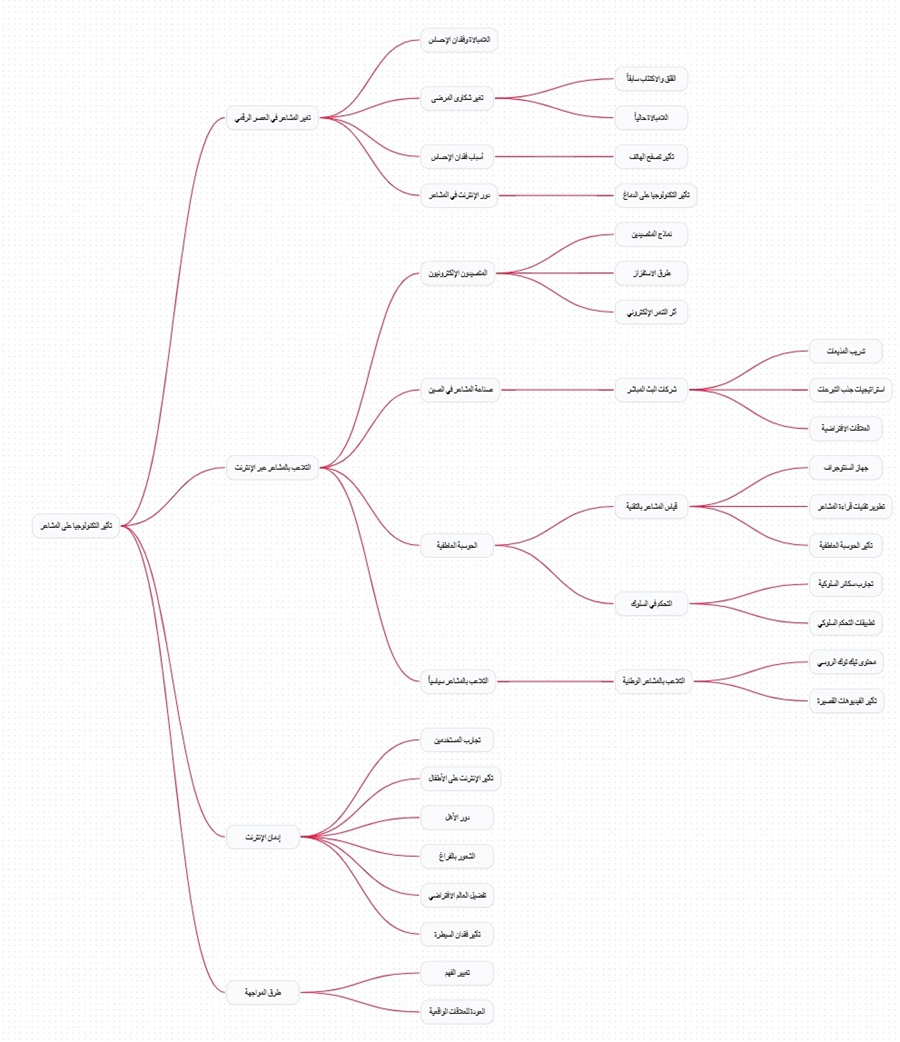

خريطة تأثير التكنولوجيا في المشاعر الانسانية

المصادر:

- بناء الهوية في المجتمعات التكنولوجية... سنغافورة نموذجًا .

- الاختراق العاطفي: كيف يمكن للهجمات الإلكترونية التلاعب بالمشاعر البشرية؟

- وجداننا في عصر الرقمنة والتكنولوجيا الحديثة: كيف تأثرت المشاعر والعلاقات بالتطور التكنولوجي؟!

- "الحوسبة العاطفية"... لتحليل المشاعر وهندستها .

- ما هي الحوسبة العاطفية وكيف تعمل وما أبرز مجالات تطبيقها.

- الحوسبة الوجدانية ِAFFECTIVE COMPUTING .

- مواقع التواصل الاجتماعي وفن التلاعب بالمشاعر.

- الذكاء الاصطناعي لخدمة الإنسانية والعالم.

ترشيحاتنا